随着智慧课堂的普及与技术的发展,学生的健康和学习状态逐渐成为教育领域的重要研究方向。长期的不良坐姿不仅会影响学生的学习效率,还可能导致健康问题,例如脊椎弯曲、高低肩等,进而对学生的生长发育和学习表现产生不良影响。因此,设计一种高效的学生坐姿监测系统,能够帮助实时发现问题并给予及时反馈,对于智慧课堂的建设与学生健康状态的改善具有重要意义。

项目信息

编号:PDV-78

大小:1.44G

运行条件

Python开发环境:

– PyCharm的安装包:PyCharm: Python IDE for Professional Developers

– PyCharm的历史安装包:PyCharm: Python IDE for Professional Developers

– Anaconda的安装包:Anaconda | Start Coding Immediately

– Python开发版本:Python==3.9

需要安装依赖包:

– pip install PyQt5== 5.15.11

– pip install Pillow==10.4.0

– pip install opencv-python==4.10.0.84

– pip install torch==2.4.0

– pip install torchvision==0.19.0

– pip install numpy== 1.26.4

– pip install matplotlib==3.9.2

项目介绍

随着智慧课堂的普及与技术的发展,学生的健康和学习状态逐渐成为教育领域的重要研究方向。长期的不良坐姿不仅会影响学生的学习效率,还可能导致健康问题,例如脊椎弯曲、高低肩等,进而对学生的生长发育和学习表现产生不良影响。因此,设计一种高效的学生坐姿监测系统,能够帮助实时发现问题并给予及时反馈,对于智慧课堂的建设与学生健康状态的改善具有重要意义。

本研究提出了一种基于YOLOv10深度学习的学生坐姿监测与语音提醒系统。系统利用先进的目标检测算法,通过实时视频捕捉学生的坐姿,并将其识别和分类为“坐姿正常状态”、“坐姿呈高低肩”、“坐姿距离过近”、“坐姿驼背状态”和“坐姿翘二郎腿”五种类别。每种类别均能准确标注学生的坐姿状态,并在识别异常坐姿时发出语音提醒,督促学生及时纠正。系统采用PyQt5开发用户界面,为用户提供了直观友好的数据可视化与交互操作平台,包括图片检测、视频检测和实时摄像头监测等功能模块。同时,系统还记录了检测结果并提供导出功能,便于教师查看学生长期的坐姿状态变化趋势。

在实验中,系统在经过优化的YOLOv10模型训练后,在测试数据集上表现出较高的检测准确率和鲁棒性。模型能够在复杂背景和多种光照条件下准确检测学生的坐姿状态,且具备较快的检测速度,满足智慧课堂实时监控的需求。语音提醒功能通过清晰的语音反馈引导学生调整坐姿,从而有效地改善课堂环境,提升学生的健康状态与学习专注力。

本研究设计的基于YOLOv10深度学习的学生坐姿监测与语音提醒系统,为智慧课堂的教学管理提供了一种创新解决方案。系统在教学中不仅起到监督与纠正的作用,还能够通过数据的可视化分析,为教育管理者提供学生健康状态的实时反馈,具有广泛的应用前景。未来,该系统还可进一步扩展功能,例如加入更多姿态类别检测、情感分析以及行为预测等模块,为智慧教育提供更加全面的技术支持。

项目文档

Tipps:可以根据您的需求进行写作,确保文档原创!

– 项目文档:写作流程

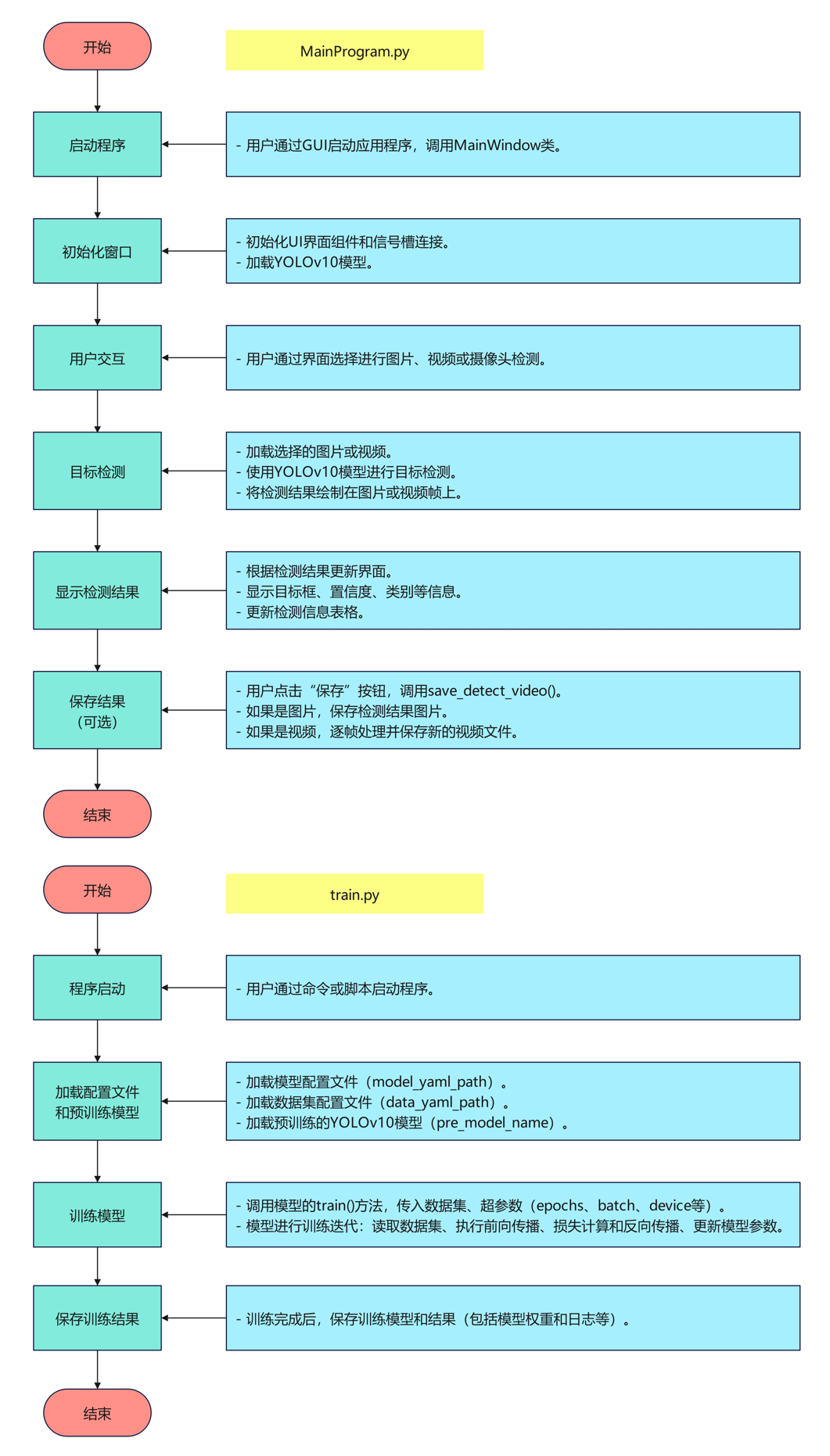

算法流程

代码讲解

Tipps:仅对imgTest.py部分代码简要讲解。该项目可以按需有偿讲解,提供后续答疑。

项目数据

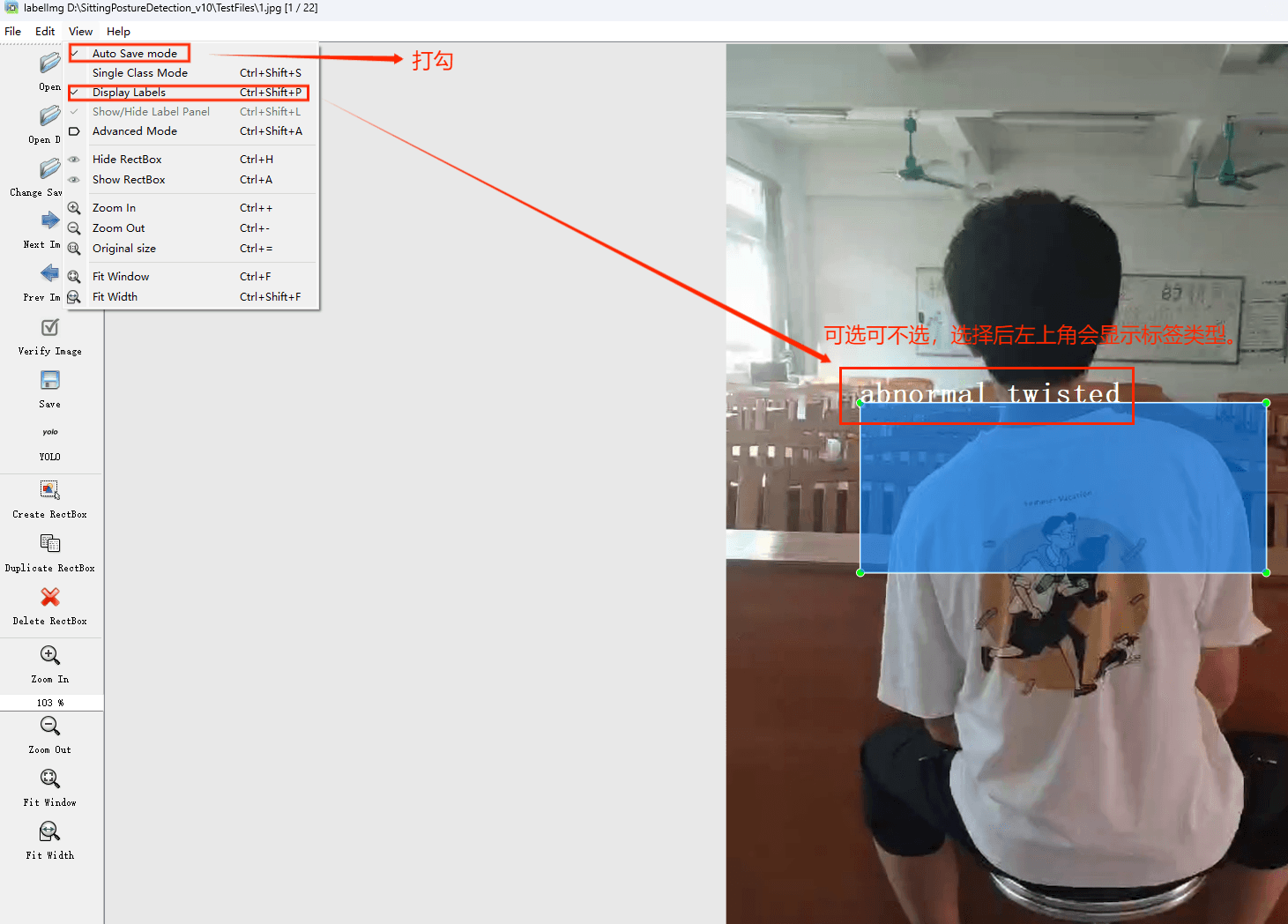

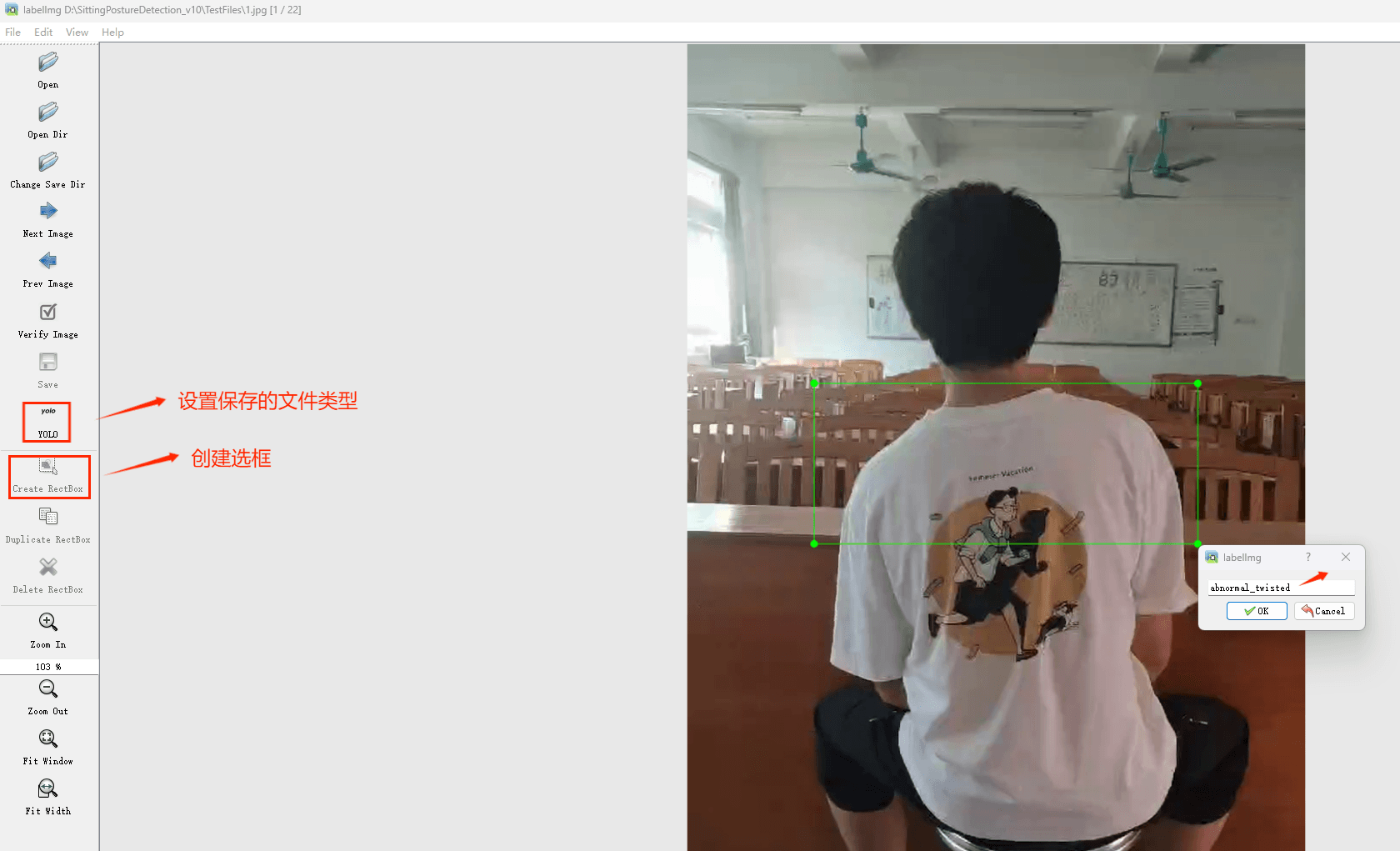

Tipps:通过搜集关于数据集为各种各样的学生坐姿图像,并使用Labelimg标注工具对每张图片进行标注,分5个检测类别,分别是’坐姿正常状态’, ‘坐姿呈高低肩’, ‘坐姿距离过近’, ‘坐姿驼背状态’, ‘坐姿翘二郎腿’。

目标检测标注工具

(1)labelimg:开源的图像标注工具,标签可用于分类和目标检测,它是用python写的,并使用Qt作为其图形界面,简单好用(虽然是英文版的)。其注释以 PASCAL VOC格式保存为XML文件,这是ImageNet使用的格式。此外,它还支持 COCO数据集格式。

(2)安装labelimg 在cmd输入以下命令 pip install labelimg -i https://pypi.tuna.tsinghua.edu.cn/simple

![]()

结束后,在cmd中输入labelimg

![]()

初识labelimg

![]()

打开后,我们自己设置一下

在View中勾选Auto Save mode

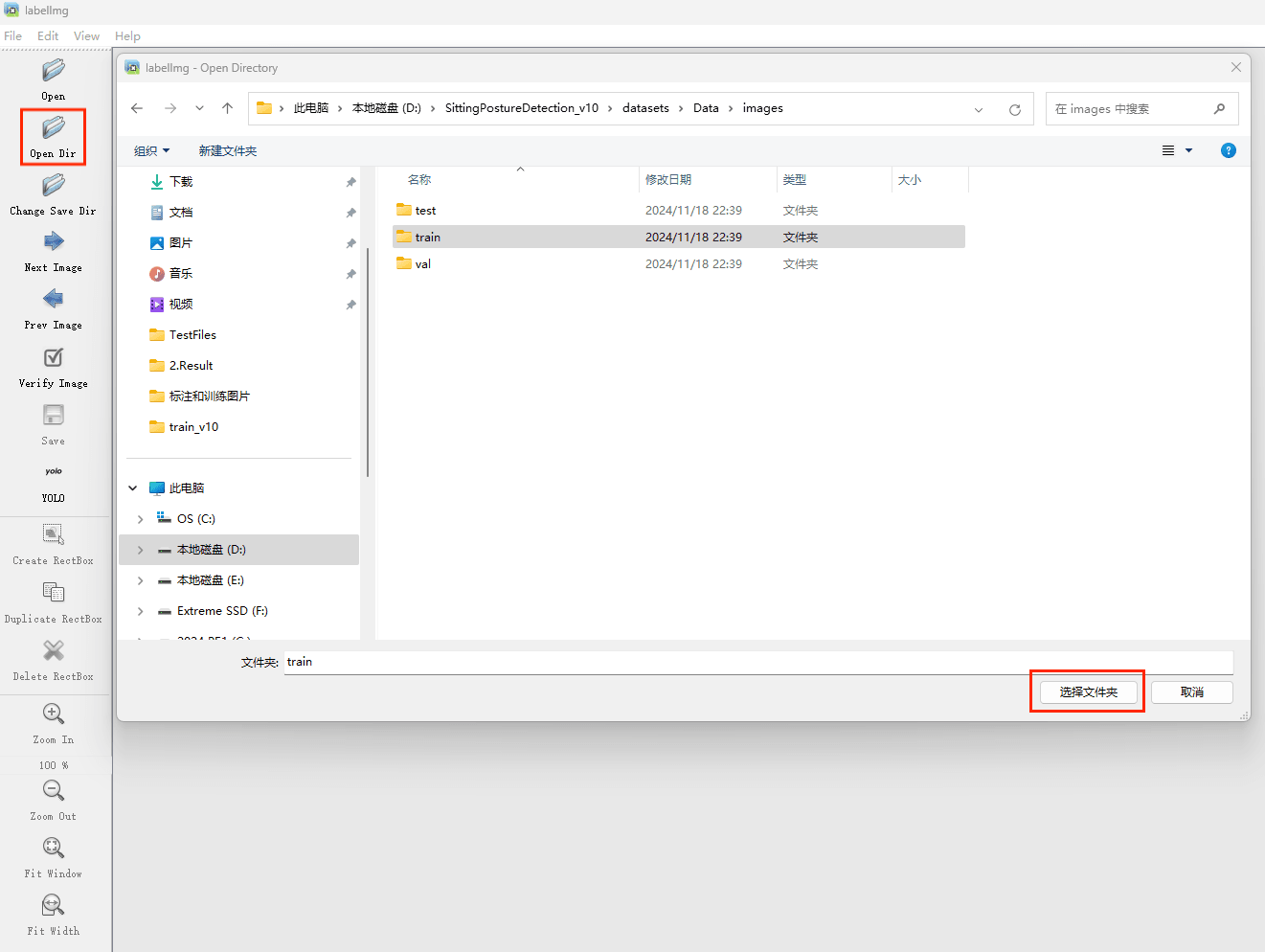

接下来我们打开需要标注的图片文件夹

并设置标注文件保存的目录(上图中的Change Save Dir)

接下来就开始标注,画框,标记目标的label,然后d切换到下一张继续标注,不断重复重复。

Labelimg的快捷键

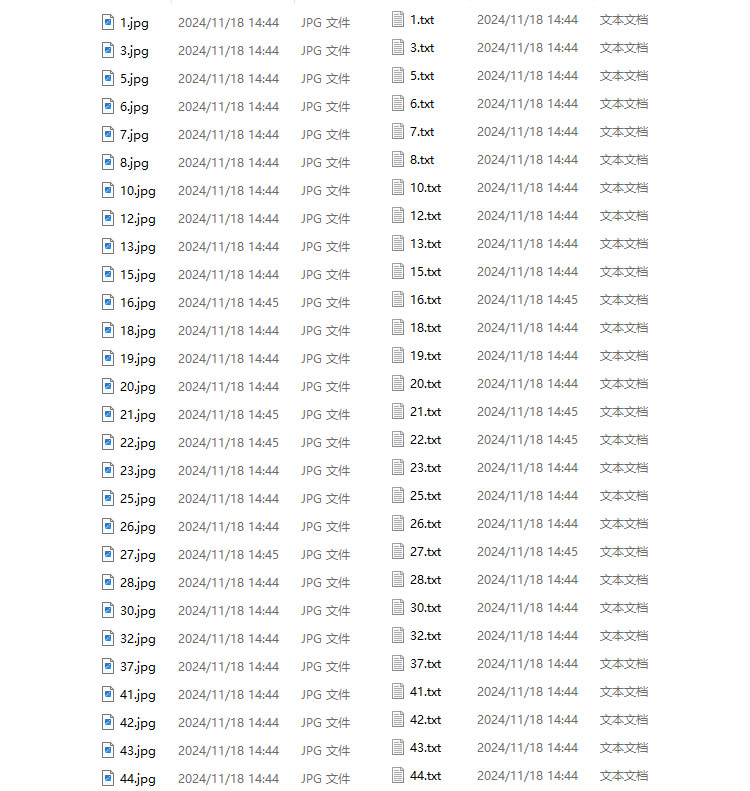

(3)数据准备

这里建议新建一个名为data的文件夹(这个是约定俗成,不这么做也行),里面创建一个名为images的文件夹存放我们需要打标签的图片文件;再创建一个名为labels存放标注的标签文件;最后创建一个名为 classes.txt 的txt文件来存放所要标注的类别名称。

data的目录结构如下:

│─img_data

│─images 存放需要打标签的图片文件

│─labels 存放标注的标签文件

└ classes.txt 定义自己要标注的所有类别(这个文件可有可无,但是在我们定义类别比较多的时候,最好有这个创建一个这样的txt文件来存放类别)

首先在images这个文件夹放置待标注的图片,这里是一类图片,就是持刀。

生成文件如下:

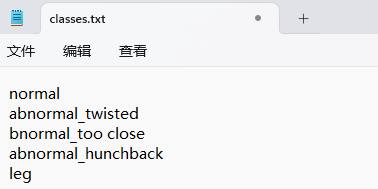

“classes.txt”定义了你的 YOLO 标签所引用的类名列表。

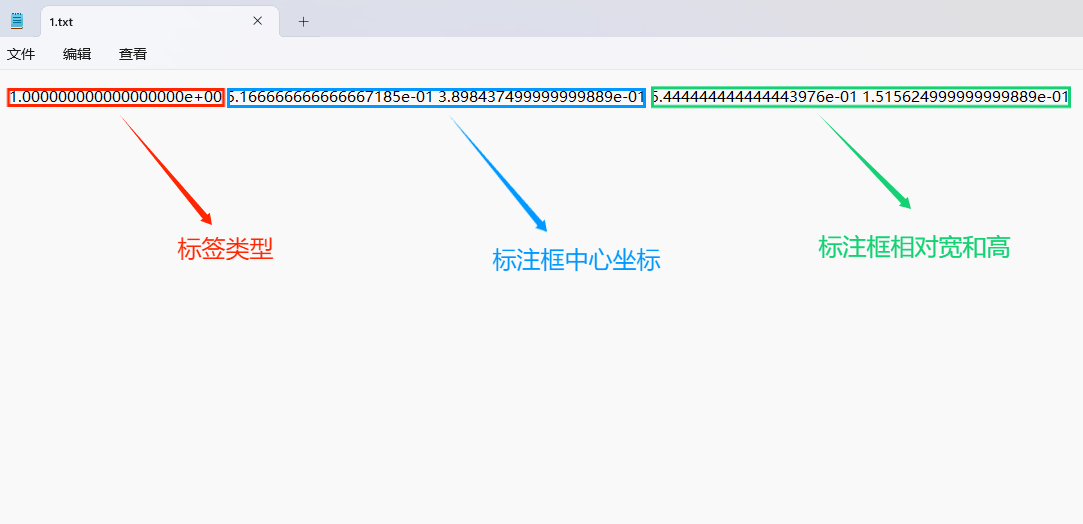

(4)YOLO模式创建标签的样式

存放标签信息的文件的文件名为与图片名相同,内容由N行5列数据组成。

每一行代表标注的一个目标,通常包括五个数据,从左到右依次为:类别id、x_center、y_center、width、height。

其中:

–x类别id代表标注目标的类别;

–x_center和y_center代表标注框的相对中心坐标;

–xwidth和height代表标注框的相对宽和高。

注意:这里的中心点坐标、宽和高都是相对数据!!!

存放标签类别的文件的文件名为classes.txt (固定不变),用于存放创建的标签类别。

完成后可进行后续的yolo训练方面的操作。

模型训练

Tipps:模型的训练、评估与推理

1.YOLOv10的基本原理

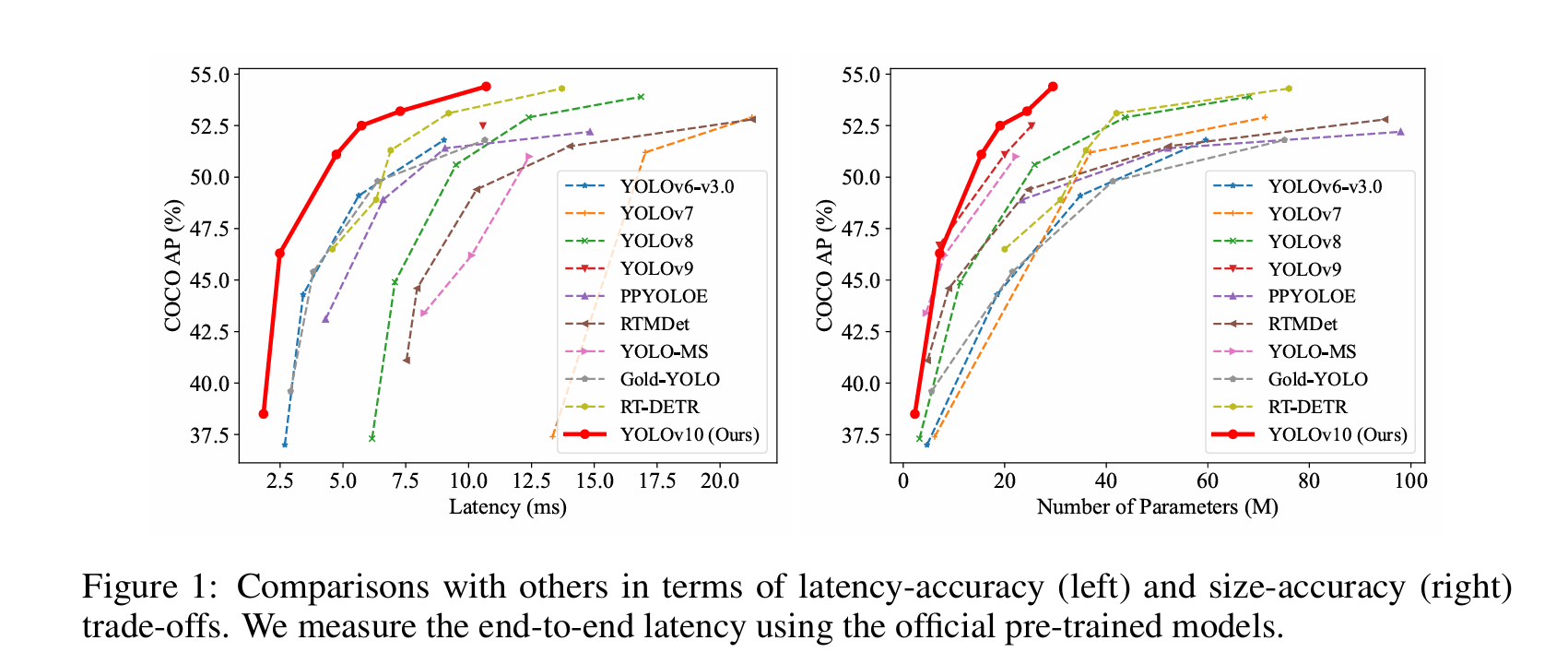

YOLOv10是YOLO最新一代版本的实时端到端目标检测算法。该算法在YOLO系列的基础上进行了优化和改进,旨在提高性能和效率之间的平衡。首先,作者提出了连续双分配方法,以实现NMS-free训练,从而降低了推理延迟并提高了模型的性能。其次,作者采用了全面的效率-准确性驱动的设计策略,对YOLO的各种组件进行了综合优化,大大减少了计算开销,并增强了模型的能力。

实验结果表明,YOLOv10在各种模型规模下都取得了最先进的性能和效率表现。例如,YOLOv10-S比RT-DETR-R18快1.8倍,同时拥有更小的参数数量和FLOPs;与YOLOv9-C相比,YOLOv10-B的延迟减少了46%,参数减少了25%,但保持了相同的性能水平。

YOLOv10创新点

(1)双标签分配

主干网络:使用增强版的CSPNet来提取图像特征,它能改善梯度流并减少计算量。

颈部:采用PAN结构汇聚不同尺度的特征,有效地实现多尺度特征融合。

一对多预测头:在训练过程中为每个对象生成多个预测,用来提供丰富的监督信号从而提高学习的准确性;在推理阶段不生效,从而减少计算量。

一对一预测头:在推理过程中为每个对象生成一个最佳预测,无需NMS操作,从而减少延迟并提高推理效率。

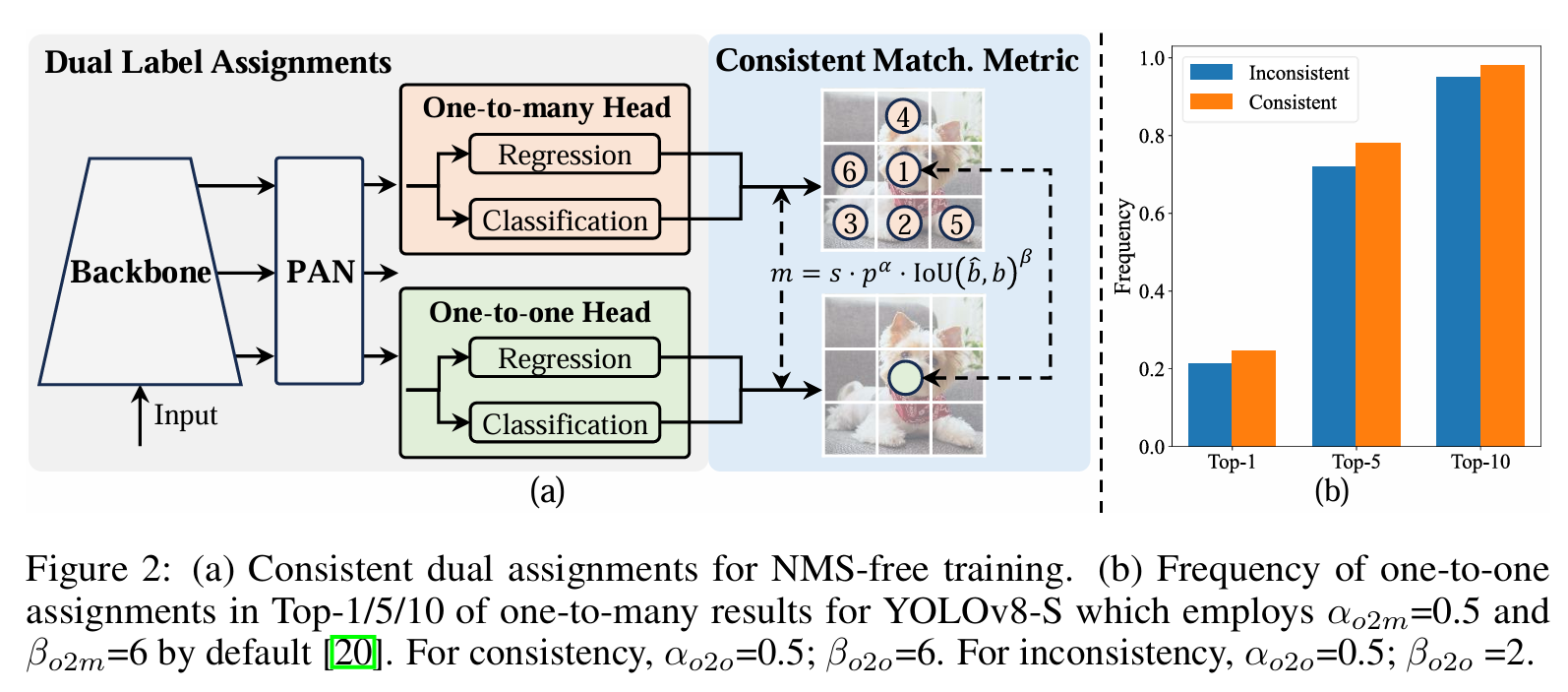

(2)模型设计改进

在模型设计方面,提出了以下几种改进点:

轻量级分类头: 通过对分类头进行轻量化设计,可以减少计算成本,而不会显著影响性能。

空间通道解耦降采样: 该方法通过分离空间和通道维度上的操作,提高了信息保留率,从而实现了更高的效率和竞争力。

排名引导块设计: 该方法根据各个阶段的冗余程度,采用不同的基本构建块,以实现更高效的模型设计。

大核深度卷积和部分自注意力模块: 这些模块可以在不增加太多计算开销的情况下提高模型的表现力。

2.数据集准备与训练

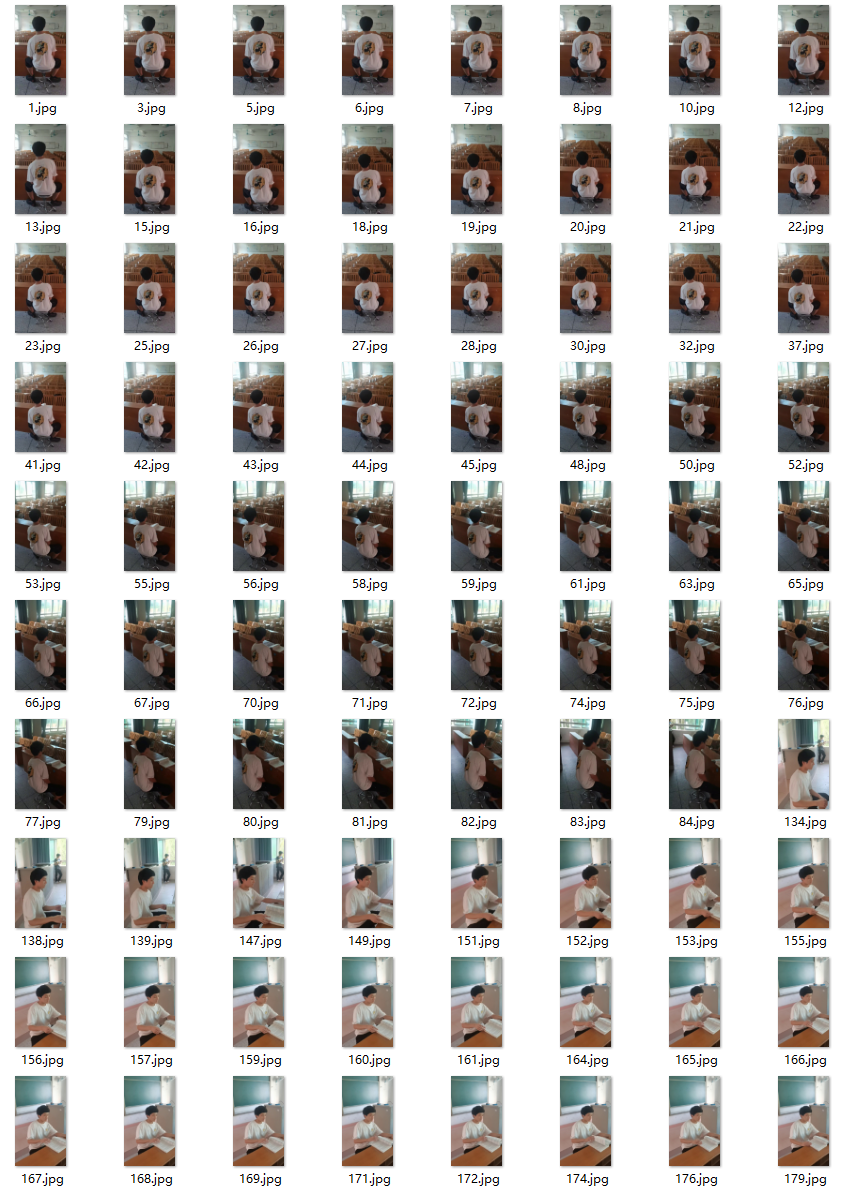

本研究使用了包含关于学生坐姿图片,并通过Labelimg标注工具对每张图像中的目标边框(Bounding Box)及其类别进行标注。然后主要基于YOLOv10n这种模型进行模型的训练,训练完成后对模型在验证集上的表现进行全面的性能评估及对比分析。模型训练和评估流程基本一致,包括:数据集准备、模型训练、模型评估。本次标注的目标类别为学生坐姿,数据集中共计包含4519张图像,其中训练集包含3163张图片,验证集包含904张图片、测试集包含452张图片。部分图像如下图所示:

部分标注如下图所示:

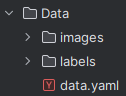

图片数据的存放格式如下,在项目目录中新建datasets目录,同时将检测的图片分为训练集与验证集放入Data目录下。

接着需要新建一个data.yaml文件,用于存储训练数据的路径及模型需要进行检测的类别。YOLOv8在进行模型训练时,会读取该文件的信息,用于进行模型的训练与验证。

data.yaml的具体内容如下:

train: C:\\7zProject\\SittingPostureDetection_v10\\datasets\\data\\images\\train 训练集的路径

val: C:\\7zProject\\SittingPostureDetection_v10\\datasets\\data\\images\\val 验证集的路径

test: C:\\7zProject\\SittingPostureDetection_v10\\datasets\\data\\images\\test 测试集的路径

这个文件定义了用于模型训练和验证的数据集路径,以及模型将要检测的目标类别。

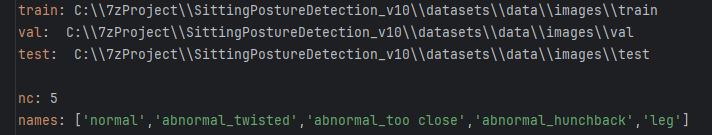

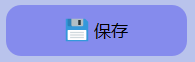

数据准备完成后,通过调用train.py文件进行模型训练,epochs参数用于调整训练的轮数,batch参数用于调整训练的批次大小(根据内存大小调整,最小为1)。

CPU/GPU训练代码如下:

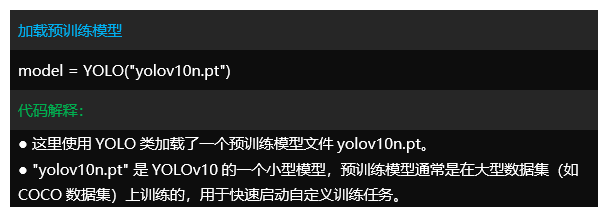

加载名为 yolov10n.pt 的预训练YOLOv8模型,yolov10n.pt是预先训练好的模型文件。

使用YOLO模型进行训练,主要参数说明如下:

(1)data=data_yaml_path: 指定了用于训练的数据集配置文件。

(2)epochs=150: 设定训练的轮数为150轮。

(3)batch=4: 指定了每个批次的样本数量为4。

(4)optimizer=’SGD’):SGD 优化器。

(7)name=’train_v10′: 指定了此次训练的命名标签,用于区分不同的训练实验。

3.训练结果评估

在深度学习的过程中,我们通常通过观察损失函数下降的曲线来了解模型的训练情况。对于YOLOv10模型的训练,主要涉及三类损失:定位损失(box_loss)、分类损失(cls_loss)以及动态特征损失(dfl_loss)。训练完成后,相关的训练过程和结果文件会保存在 runs/ 目录下,具体如下:

各损失函数作用说明:

定位损失box_loss:预测框与标定框之间的误差(GIoU),越小定位得越准;

分类损失cls_loss:计算锚框与对应的标定分类是否正确,越小分类得越准;

动态特征损失(dfl_loss):DFLLoss是一种用于回归预测框与目标框之间距离的损失函数。在计算损失时,目标框需要缩放到特征图尺度,即除以相应的stride,并与预测的边界框计算Ciou Loss,同时与预测的anchors中心点到各边的距离计算回归DFLLoss。这个过程是YOLOv8训练流程中的一部分,通过计算DFLLoss可以更准确地调整预测框的位置,提高目标检测的准确性。

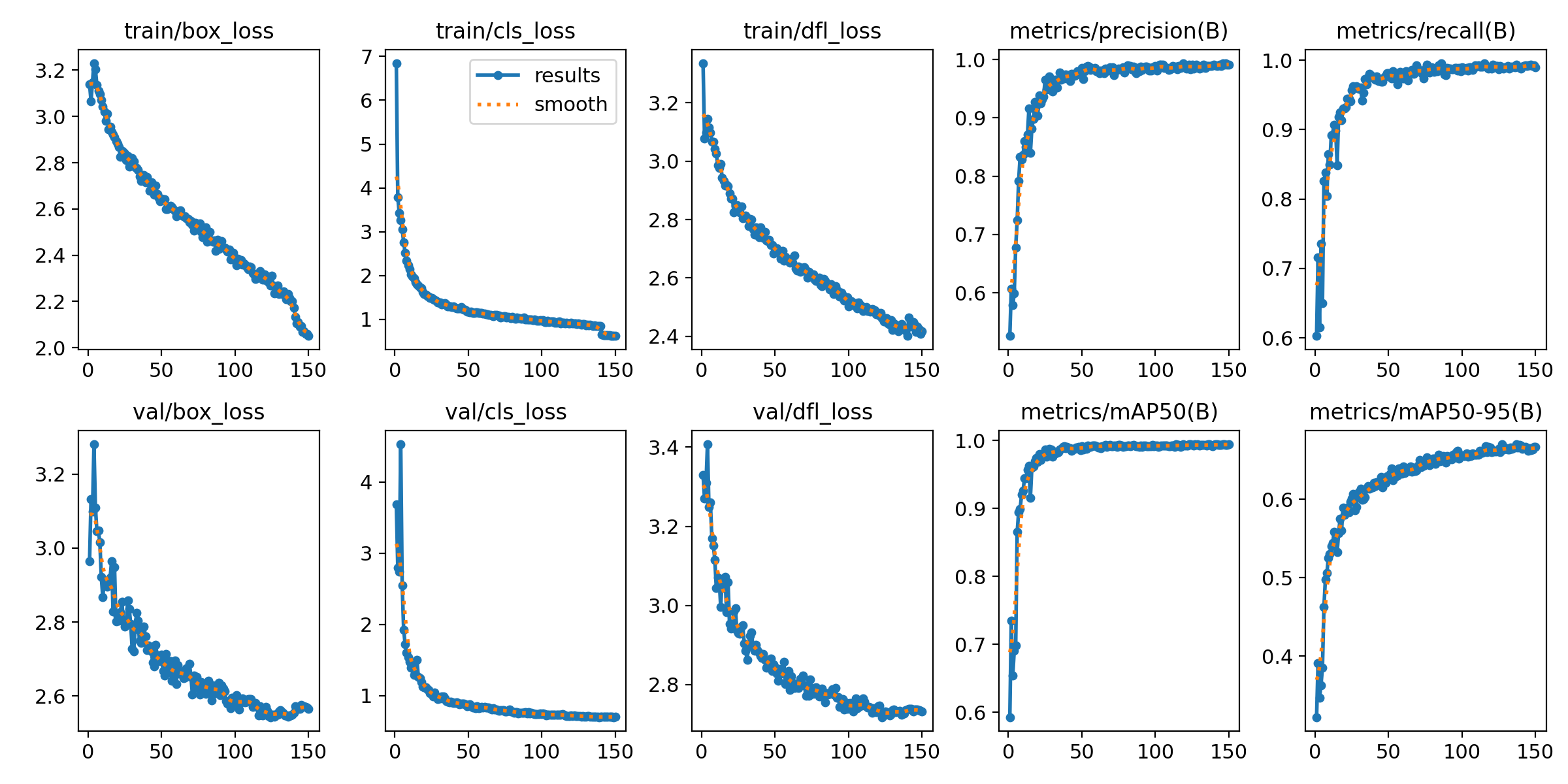

训练结果如下:

这张图展示了YOLOv10模型在训练和验证过程中的多个重要指标的变化趋势,具体如下:

train/box_loss:

(1)表示训练集上的边界框回归损失,用于衡量预测边界框与真实目标框之间的误差。

(2)趋势:损失值从 3.2 开始逐渐下降到接近 2,表明模型的边界框定位能力在不断优化。

train/cls_loss:

(1)表示训练集上的分类损失,用于衡量目标分类的误差。

(2)趋势:损失值从约 7 开始迅速下降到接近 0.6,说明模型的分类性能在逐渐提升。

train/dfl_loss:

(1)表示训练集上的分布焦点损失(DFL),与边界框预测的精度相关。

(2)趋势:损失值从 3.2 降到约 2.4,表明模型对目标边界的定位精度持续提高。

metrics/precision(B):

(1)表示训练集上的精确率,衡量模型预测为正样本的结果中有多少是正确的。

(2)趋势:从约 0.6 开始迅速上升到接近 1,表明模型的误检率逐步降低。

metrics/recall(B):

(1)表示训练集上的召回率,衡量实际正样本中有多少被模型正确预测。

(2)趋势:从约 0.6 开始迅速上升到接近 1,表明模型的漏检率逐步减少。

val/box_loss:

(1)表示验证集上的边界框回归损失,类似于训练集的 box_loss,用于评估模型的泛化能力。

(2)趋势:损失值逐渐下降,表明模型在验证集上的边界框定位能力不断提升。

val/cls_loss:

(1)表示验证集上的分类损失,用于衡量模型在验证集上的分类性能。

(2)趋势:损失值从约 4 开始下降到接近 1,显示模型的分类能力在验证集上表现良好。

val/dfl_loss:

(1)表示验证集上的分布焦点损失,反映了模型在验证集上的定位精度。

(2)损失值从 3.4 降到约 2.8,表明模型在验证集上的定位能力也在提升。

metrics/mAP50(B):

(1)表示验证集上 mAP(平均精度)在 IoU 阈值为 50% 的情况下的结果。

(2)趋势:mAP 从 0.6 上升到接近 1,表明模型对验证集中目标的检测效果非常好。

metrics/mAP50-95(B):

(1)表示验证集上 mAP 在多个 IoU 阈值(50%-95%)下的平均值。

(2)趋势:mAP 从 0.4 上升到接近 0.7,说明模型在严格检测条件下也具备较好的泛化能力。

总结:

(1)损失函数下降:训练和验证的损失函数均呈下降趋势,表明模型在持续学习并优化。

(2)性能提升:精确率、召回率和 mAP 指标持续上升,说明模型的检测和分类性能不断提高。

(3)验证效果良好:验证集上的指标接近训练集,说明模型具有较好的泛化能力。

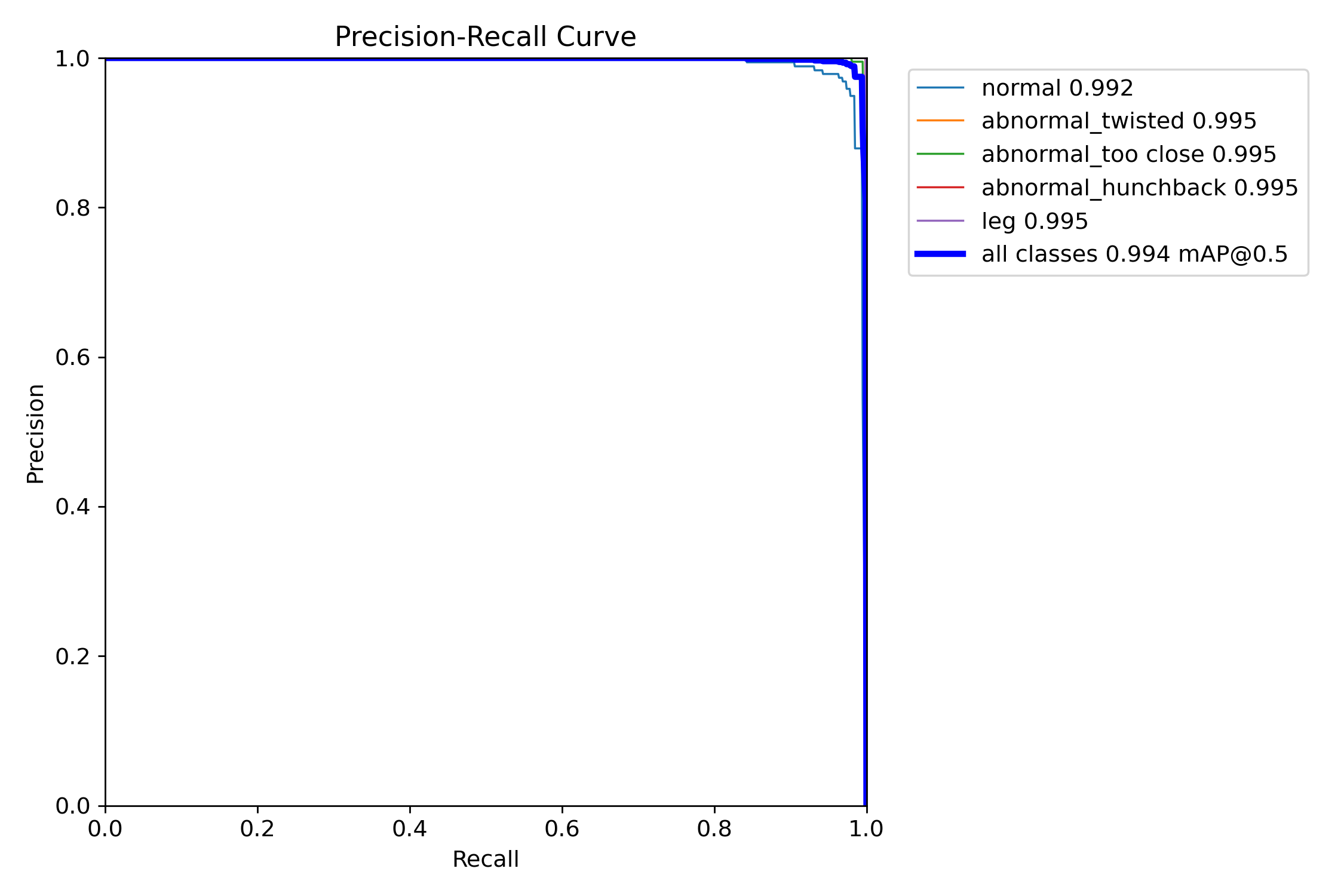

这张图展示的是 Precision-Recall 曲线,用于评估模型在不同类别下的检测性能。以下是详细解释:

图中各类别曲线

每种坐姿类别都有一条单独的曲线,右侧的图例中列出了类别名称和各类别的 mAP@0.5(平均精度)值:

(1)normal (坐姿正常状态): mAP = 0.992

(2)abnormal_twisted (坐姿高低肩): mAP = 0.995

(3)abnormal_too close (坐姿距离过近): mAP = 0.995

(4)abnormal_hunchback (坐姿驼背状态): mAP = 0.995

(5)leg (坐姿翘二郎腿): mAP = 0.995

从这些值可以看出,所有类别的 mAP 值都非常接近 1,表明模型对每种坐姿类别的检测效果都很优异。

蓝色加粗曲线 (all classes)

(1)这条加粗曲线表示所有类别的综合 P-R 曲线。

(2)图例中给出的 mAP@0.5 = 0.994,说明模型整体的平均精度非常高。

总结

(1)高精确率和高召回率:曲线接近右上角,说明模型能有效地减少漏检和误检。

(2)类别之间的平衡性:各类别的曲线几乎重叠,表明模型对每个类别的检测性能较为均衡,没有明显的偏差。

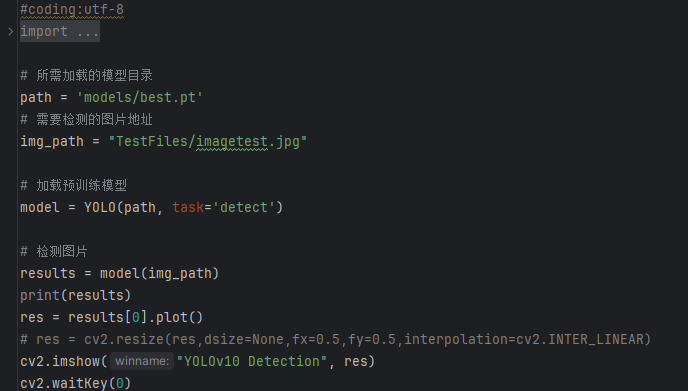

4.检测结果识别

模型训练完成后,我们可以得到一个最佳的训练结果模型best.pt文件,在runs/train/weights目录下。我们可以使用该文件进行后续的推理检测。

imgTest.py 图片检测代码如下:

引入所需库:

(1)从 ultralytics 库中导入 YOLOv10 模型类。

(2)导入 OpenCV 库用于图像的显示。

指定模型和图像路径:

(1)path 是你要加载的预训练模型的路径,这里指向 models/best.pt,即保存了最佳训练权重的模型。

(2)img_path 是你需要检测的图片路径,这里指向一个特定的测试图片。

加载预训练模型:

(1)通过 YOLOv10(path, task=’detect’) 加载 YOLOv10 预训练模型,task=’detect’ 表示这是一个检测任务。

执行检测:

(1)使用 model(img_path) 对指定的图片进行检测。检测的结果保存在 results 中。

显示检测结果:

(1)使用 results[0].plot() 生成带有检测结果的图片。

(2)然后通过 OpenCV 的 cv2.imshow() 显示结果图片,并通过 cv2.waitKey(0) 保持窗口开启直到按键按下。

此代码的功能是加载一个预训练的YOLOv10模型,对指定的图片进行目标检测,并将检测结果显示出来。

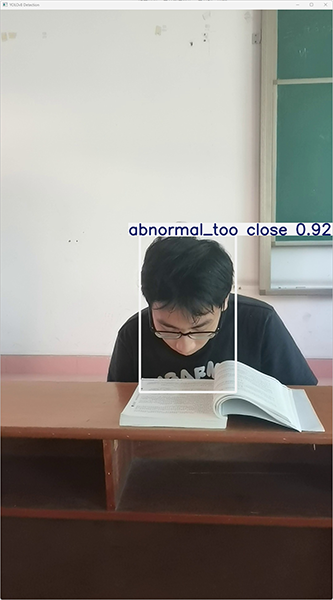

执行imgTest.py代码后,会将执行的结果直接标注在图片上,结果如下:

YOLOv10检测系统的推理结果日志。以下是对该结果的解析:

这段输出是基于YOLOv10模型对图片“imagetest.jpg”进行检测的结果,具体内容如下:

图像信息:

(1)处理的图像路径为:TestFiles/imagetest.jpg。

(2)图像尺寸为 640×384 像素。

检测结果:

(1)检测到的类别:1个异常坐姿,分类为 abnormal_too close(坐姿距离过近)

处理速度:

(1)预处理时间: 4.0 毫秒

(2)推理时间: 51.8 毫秒

(3)后处理时间: 31.3毫秒

系统在检测坐姿方面运行顺利,并成功检测出异常坐姿(坐姿距离过近)。检测速度非常快,可以满足实时性要求。

运行效果

– 运行 MainProgram.py

1.主要功能:

(1)可用于实际场景中的学生坐姿;

(2)支持图片、视频及摄像头进行检测,同时支持图片的批量检测;

(3)界面可实时显示目标位置、目标总数、置信度、用时等信息;

(4)支持图片或者视频的检测结果保存;

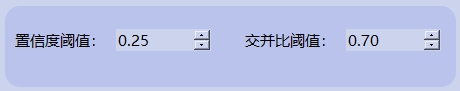

2.检测参数设置:

(1)置信度阈值:当前设置为0.25,表示检测系统只会考虑置信度高于25%的目标进行输出,置信度越高表示模型对检测结果的确信度越高。

(2)交并比阈值:当前设置为0.70,表示系统只会认为交并比(IoU)超过70%的检测框为有效结果。交并比是检测框与真实框重叠区域的比值,用于衡量两个框的相似程度,值越高表明重叠程度越高。

这两个参数通常用于目标检测系统中,调整后可以影响模型的检测精度和误检率。

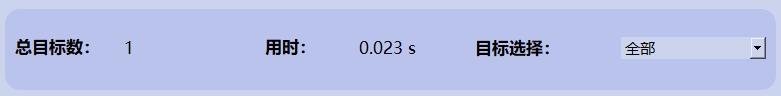

这张图表显示了基于YOLOv10模型的目标检测系统的检测结果界面。以下是各个字段的含义解释:

用时(Time taken):

(1)这表示模型完成检测所用的时间为0.023秒。

(2)这显示了模型的实时性,检测速度非常快。

目标数目(Number of objects detected):

(1)检测到的目标数目为1,表示这是当前检测到的第1个目标。

目标选择(下拉菜单):全部:

(1)这里有一个下拉菜单,用户可以选择要查看的目标类型。

(2)在当前情况下,选择的是“全部”,意味着显示所有检测到的目标信息。

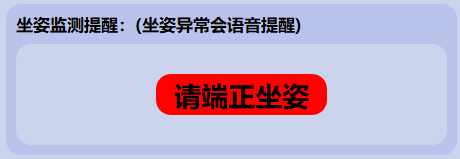

语音提醒(Voice Reminder):

(1)坐姿异常语音提醒:请端正坐姿

3.目标检测类型:

结果(Result):

(1)当前选中的结果为 “坐姿距离过近”,表示系统正在高亮显示检测到的“bnormal_too close”。

置信度(Confidence):

(1)这表示模型对检测到的目标属于“坐姿距离过近”类别的置信度为91.62%。

(2)置信度反映了模型的信心,置信度越高,模型对这个检测结果越有信心。

目标位置(Object location):

(1)xmin: 303, ymin: 768:目标的左上角的坐标(xmin, ymin),表示目标区域在图像中的位置。

(2)xmax: 591, ymax: 1140:目标的右下角的坐标(xmax, ymax),表示目标区域的边界。

这些坐标表示在图像中的目标区域范围,框定了检测到的“坐姿距离过近”的位置。

这张图展示了学生坐姿的一次检测结果,包括检测时间、检测到的种类、各行为的置信度、目标的位置信息等。用户可以通过界面查看并分析检测结果,提升学生坐姿检测的效率。

4.图片检测说明

(1)学生坐姿高低肩

(2)学生坐姿距离过近

(3)学生坐姿翘二郎腿

(4)学生坐姿高驼背

(5)学生坐姿正常

点击打开图片按钮,选择需要检测的图片,或者点击打开文件夹按钮,选择需要批量检测图片所在的文件夹。

操作演示如下:

(1)点击目标下拉框后,可以选定指定目标的结果信息进行显示。

(2)点击保存按钮,会对检测结果进行保存,存储路径为:save_data目录下。

检测结果:系统识别出图片中的学生坐姿,并显示检测结果,包括总目标数、用时、目标类型、置信度、以及目标的位置坐标信息。

5.视频检测说明

点击视频按钮,打开选择需要检测的视频,就会自动显示检测结果,再次点击可以关闭视频。

点击保存按钮,会对视频检测结果进行保存,存储路径为:save_data目录下。

检测结果:系统对视频进行实时分析,检测到学生坐姿并显示检测结果。表格显示了视频中多个检测结果的置信度和位置信息。

这个界面展示了系统对视频帧中的多目标检测能力,能够准确识别学生坐姿,并提供详细的检测结果和置信度评分。

6.摄像头检测说明

点击打开摄像头按钮,可以打开摄像头,可以实时进行检测,再次点击,可关闭摄像头。

检测结果:系统连接摄像头进行实时分析,检测到学生坐姿并显示检测结果。实时显示摄像头画面,并将检测到的学生坐姿位置标注在图像上,表格下方记录了每一帧中检测结果的详细信息。

7.保存图片与视频检测说明

点击保存按钮后,会将当前选择的图片(含批量图片)或者视频的检测结果进行保存。

检测的图片与视频结果会存储在save_data目录下。

保存的检测结果文件如下:

(1)图片保存

(2)视频保存

– 运行 train.py

1.训练参数设置

(1)epochs 参数设置了训练的轮数。在此设置下,模型将对数据集进行150轮的训练。

(2)device=0 参数指定了在哪个设备上运行训练过程。0通常表示使用第一个GPU。

(3)这里指定训练在GPU上进行。

虽然在大多数深度学习任务中,GPU通常会提供更快的训练速度。

但在某些情况下,可能由于硬件限制或其他原因,用户需要在CPU上进行训练。

温馨提示:在CPU上训练深度学习模型通常会比在GPU上慢得多,尤其是像YOLOv10这样的计算密集型模型。除非特定需要,通常建议在GPU上进行训练以节省时间。

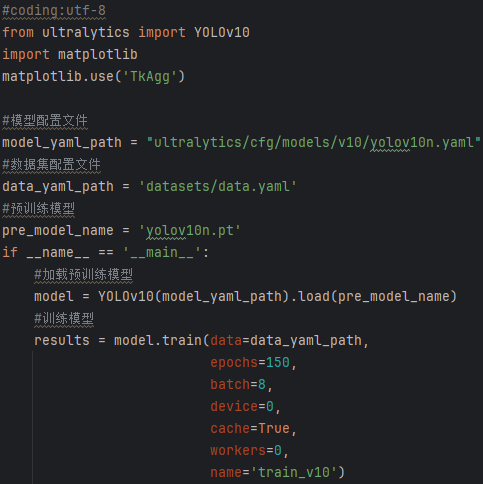

2.训练日志结果

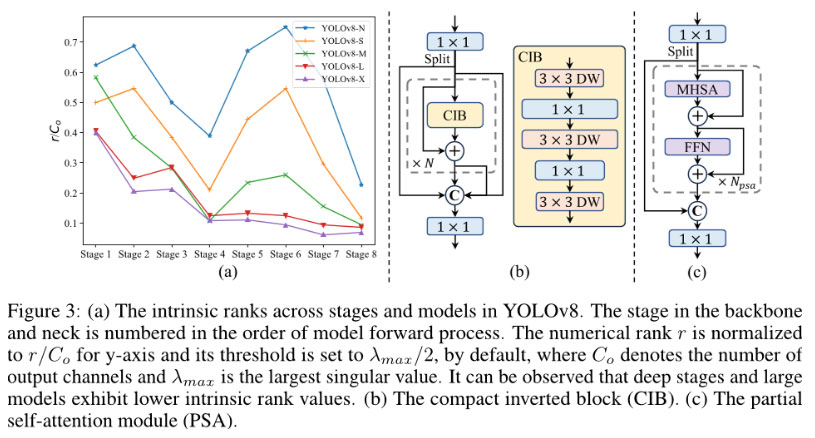

这张图展示了使用YOLOv10进行模型训练的详细过程和结果。

训练总时长:

(1)150个Epoch在2.412小时内完成,说明在使用NVIDIA GeForce RTX 4070 Ti SUPER GPU的情况下训练速度较快。

综合指标:

(1)mAP50 (所有类别):达到 99.4%,表现极为优秀。

(2)mAP50-95 (所有类别):达到 67%,在不同IoU阈值下保持较高精度。

速度:

(1)0.2ms 预处理时间

(2)1.1ms 推理时间

(3)0.1ms 后处理时间

结果保存:

(1)Results saved to runs\detect\train_v10:验证结果保存在 runs\detect\train_v10 目录下。

完成信息:

(1)Process finished with exit code 0:表示整个验证过程顺利完成,没有报错。

总结:

1.模型性能:YOLOv10 模型在 mAP50 和 mAP50-95 上表现出色,对所有类别的检测都非常精准。

2.优化方向:

(1)提高 mAP50-95:可以尝试增加更多复杂场景的数据,提高模型在高IoU阈值下的性能。

(2)减少训练时间:通过调整Batch Size或进一步优化硬件配置,提高训练效率。

(3)泛化能力测试:使用完全不同的测试集验证模型的泛化能力。

远程部署

Tipps:购买后可有偿协助安装,确保运行成功。

– 远程工具:Todesk 、向日葵远程控制软件

– 操作系统:Windows OS

– 客服QQ:3666308803

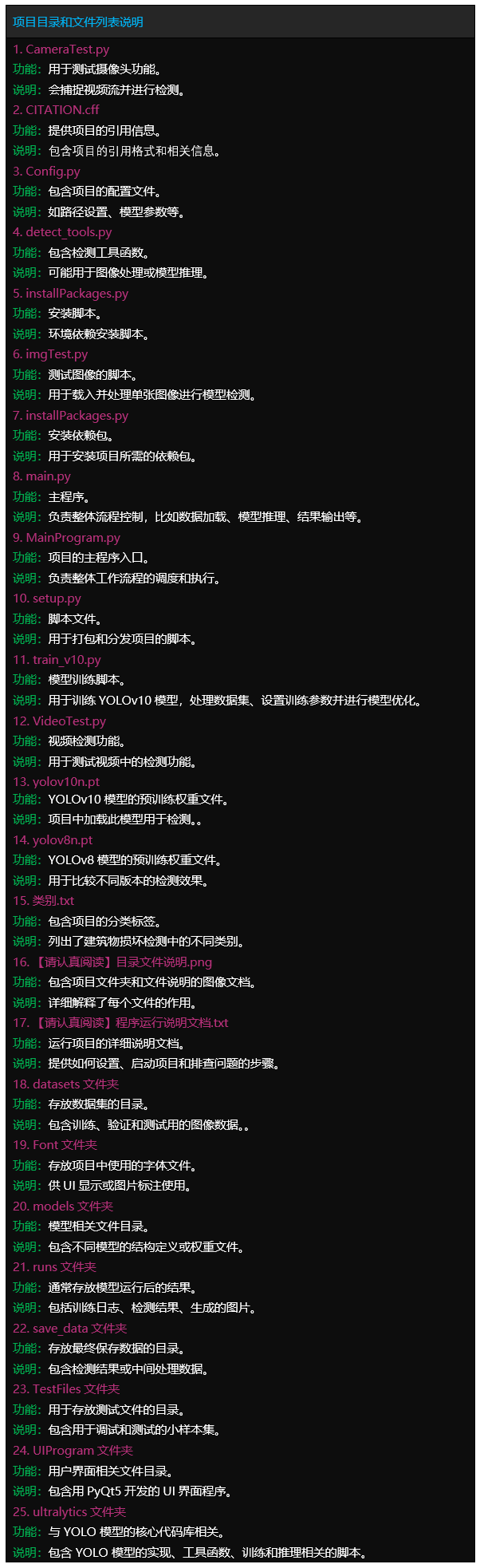

项目文件

文件目录

Tipps:完整项目文件清单如下:

项目目录

– 1.Code (完整代码:确保运行成功)

– 2.Result (运行结果:真实运行截图)

– 3.Demo (演示视频:真实运行录制)

评论(0)